大学生向けAIツール完全ガイド2025-2026!レポート・論文・プログラミング用途別おすすめと学割活用法 「AIツールが多すぎて、どれを使えばいいか分からない…」そんな悩みを抱えていませんか? レポート作成、論文検索、プログラミング、英語校正など、大学生活では様々な場面でAIツールが役立ちます。しかし、無料版と有料版の違いや、学割の適用方法、大学のガイドラインに沿った正しい使い方を知らないと、せ…

- Home

- AI, レポート・論文作成におすすめのノートパソコン

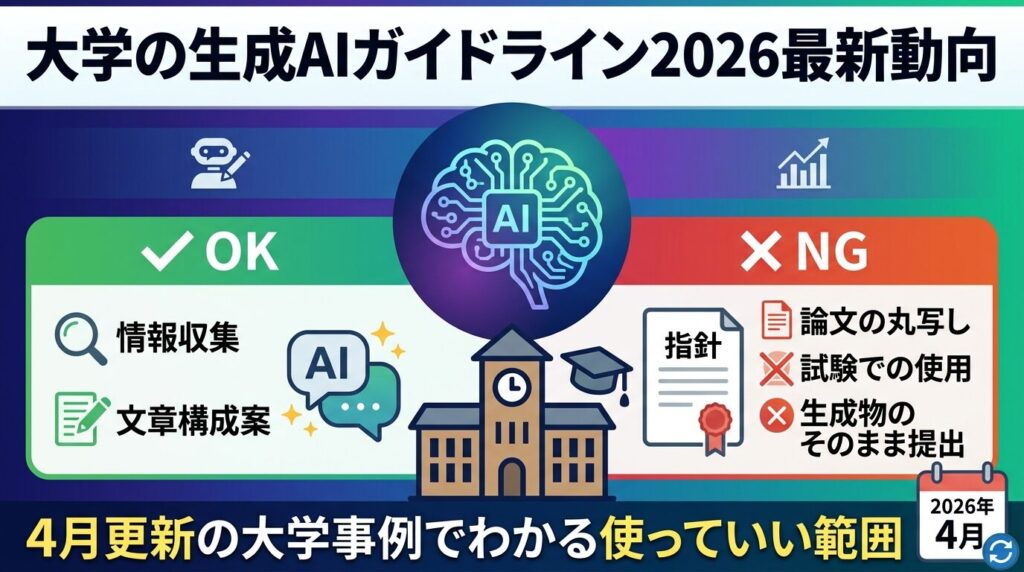

- 大学の生成AIガイドライン2026最新動向|4月更新の大学事例でわかる使っていい範囲

大学の生成AIガイドライン2026最新動向|4月更新の大学事例でわかる使っていい範囲

- 公開日:2026/3/7

- 最終更新日:

- AI, レポート・論文作成におすすめのノートパソコン

- 大学の生成AIガイドライン2026最新動向|4月更新の大学事例でわかる使っていい範囲 はコメントを受け付けていません

大学のレポートや発表で生成AIを使いたいと思っても、「どこまでならセーフなのか」「そのまま不正扱いされないか」が不安ですよね。2026年4月は、大学ごとのルール差が残る一方で、実務に役立つ具体例が増えてきたタイミングです。

- 2026年の大学における生成AIルールの最新傾向

- 北里大学・滋賀県立大学の4月更新事例から見える共通ルール

- レポート・発表・下書き・要約で「使ってよい範囲」を判断する基準

こんな方におすすめです

- 大学レポートでChatGPTやGeminiを使いたいが、線引きがわからない方

- 「下書きだけなら大丈夫?」と不安を感じている大学生

- 先生に確認すべき場面や、AI利用の明記方法を知りたい方

本記事では、大学の生成AIガイドライン2026最新動向をもとに、4月更新の大学事例を踏まえた使い方の境界線をわかりやすく解説します。(専門知識は不要です!)

💡 生成AIの透明性は「電卓を使ったかどうかの申告」に少し似ています

大学で重視されやすいのは、生成AIを使った事実そのものよりも、どこで何のために使ったかを説明できるかどうかです。電卓の使用が禁止された試験で黙って使えば不正になりやすい一方、使用可の課題で計算補助として申告しながら使うなら問題になりにくいのと似ています。ただし、生成AIは電卓と違って、誤情報・著作権・個人情報のリスクも伴うため、まったく同じではありません。

2026年、大学の生成AIルールはどう変わったのか

まず土台として確認したいのが、文部科学省の「大学・高専における生成AIの教学面の取扱いについて」です。文部科学省は、各大学が教育の実態や今後の状況変化を踏まえて、主体的に指針を見直していくことが重要だと整理しています。

この流れを見ると、公開事例ベースでは、大学の生成AIルールは「一律禁止」よりも、「授業・課題ごとに条件付きで利用を認める」方向に寄っています。つまり、今の大学生が最初に知るべきなのは、「大学でAIが使えるかどうか」という二択ではなく、「どの授業で、どの範囲まで、どんな条件で使えるのか」です。

元記事でも触れたように、海外では透明性や説明責任を重視する流れが強まっています。たとえばEUでは、一般目的AIモデルに関するガイドラインが公開され、透明性や責任ある運用がより重視されています。ただし、日本の大学生がレポート提出時に直接見るべきルールは、やはり所属大学と授業担当教員の指示です。

⚠️ 先に結論です

2026年の大学生成AIルールは、「使っただけで不正」ではなく、「担当教員の指示に従うこと」「AIの出力をそのまま提出しないこと」「使った場合は透明性を持って明記すること」が中心です。ここを外すと、不正行為に近づきやすくなります。

4月更新の大学事例で見える共通ルール

北里大学4月1日版で明確になったこと

北里大学の2026年4月1日版ガイドラインでは、生成AIの使用を一律に禁止しないことが明記されました。その一方で、生成AIは学修の代替ではなく補助的な手段であり、出力結果をそのまま正解や事実として扱ってはいけないこと、課題やレポートの最終責任は利用者自身にあること、使用可否と範囲は担当教員の指示に従うことがはっきり示されています。

さらに北里大学は、アイデア出し、難解な内容の理解補助、要約、学習計画の相談、外国語学習の補助、プログラミング学習の補助、レポートやディスカッション発表の準備など、活用が推奨される場面まで具体化しました。ここが重要で、2026年4月時点では、大学側も「AIをどう避けるか」ではなく、「どこなら学びを深める補助になるか」を具体的に示し始めています。

滋賀県立大学4月3日公開で明確になったこと

滋賀県立大学の2026年4月3日公開ガイドラインでは、生成AIの出力をそのままレポート等に使用してはいけないこと、授業資料や研究データなどに含まれる個人情報・機密情報・未公開情報を入力してはいけないこと、生成AIを利用した場合は必ず明記することが学生向けにはっきり示されています。

特に実務上わかりやすいのは、利用時の明記内容まで具体化している点です。滋賀県立大学は、利用した生成AIの名称、利用日、利用目的、利用箇所などをレポート末尾や脚注に記載するよう案内しています。また、授業によって利用制限や全面禁止がありうるため、授業担当教員の指示に従うことも強調しています。

2校に共通する読み方

北里大学と滋賀県立大学の4月更新を並べて読むと、共通ルールはかなり明確です。ひとことで言うと、「一律禁止ではない」「そのまま提出は不可」「最終責任は自分」「担当教員の指示が優先」です。

つまり、大学の生成AIルールは「AIを使ったかどうか」で切るのではなく、「補助利用か、代作か」「透明性があるか」「課題の目的を壊していないか」で切る段階に入っています。

どこまで使っていい? OK・要確認・NGの境界線

短く言えば、アイデア出しや表現調整は認められやすく、本文の丸投げや無申告はNGになりやすいです。 境界が曖昧な場合は、提出前ではなく使う前に担当教員へ確認するほうが安全です。

OKになりやすい使い方

アイデア出し、論点整理、構成のたたき台、表現の見直し、要約の補助、翻訳補助、用語の理解補助など。自分の思考や調査を深めるための補助利用です。

教員確認が必要な使い方

下書き生成、引用候補の洗い出し、発表原稿の大部分の整形、構成案のみ可なのか本文生成も可なのかが曖昧なケースです。課題の目的を壊しやすい場面は必ず確認したほうが安全です。

NGになりやすい使い方

AIが作った本文をほぼそのまま提出すること、未確認の出典や引用を使うこと、利用申告が必要なのに隠すこと、禁止された課題で使うことです。

OKになりやすい使い方

2026年時点で比較的認められやすいのは、学びを補助する範囲の利用です。たとえば、テーマの整理、論点の洗い出し、複数の視点の比較、わかりにくい概念の言い換え、文章表現の改善、英語文の理解補助などは、多くの大学ガイドラインと相性がよい使い方です。

北里大学も、要約、外国語学習、プログラミング学習の補助、レポートやディスカッション発表時の準備を推奨場面として挙げています。ただし、ここでいう「準備」は、自分の代わりに完成品を作らせることではありません。あくまで、自分で考えるための補助として使うのが前提です。

レポート用途に絞った具体例は、大学レポートでAIを使う具体例の記事でも整理しています。使い方に迷う場合は、先に「補助なのか、本文の代作なのか」を分けて考えると判断しやすくなります。

NGになりやすい使い方

逆に危険なのは、AIの出力をそのまま提出することです。滋賀県立大学は「生成AIの出力をそのままレポート等に使用してはいけません」と明記し、北里大学も「出力結果をそのまま正解・事実として扱ってはならない」としています。

もう一つ見落とされやすいのが、AIが作った出典や引用を未確認のまま使うことです。生成AIはもっともらしい文献名やURLを出すことがありますが、それが実在するとは限りません。引用や参考文献は、必ず一次資料や実際の論文・公式ページに当たり、自分で確認してください。

教員確認が必要になりやすい境界線

実際に迷いやすいのは、「下書きならいいのか」「構成案は可でも本文生成は不可なのか」「発表スライドの文章整形はどこまで許されるのか」といったグレーゾーンです。北里大学のガイドラインでも、授業・課題では授業科目ごとに担当教員へ確認するよう示されています。

特に、研究データ、授業配布資料、ゼミ内の未公開情報、共同研究に関わる内容を入れる場合は、単にルール違反というだけでなく、情報管理の問題にもつながります。このラインに入ったら、自己判断で進めないほうが安全です。

先生に確認すべき場面と、AI利用の明記はどう書く?

ここで大事なのは、「大学全体のルールがこうだから大丈夫」と考えないことです。実際には、大学全体の方針よりも、シラバスや課題要項、授業担当教員の指示が優先される場面が多くあります。北里大学も滋賀県立大学も、この点をかなり明確に書いています。

⚠️ こんな場面は、先に確認したほうが安心です

構成案だけAIに出させたい場合、本文の言い換えまで依頼したい場合、発表原稿の大半を整形したい場合、授業資料や自分の調査メモを丸ごと貼り付けたい場合は、後から説明しづらくなりやすいため、提出前ではなく使う前に確認したほうが安全です。

明記に入れたい基本4項目

滋賀県立大学の学生向けガイドラインは、利用した生成AIの名称、利用日、利用目的、利用箇所の記載を求めています。2026年の実務では、この4項目を押さえておくとかなり整理しやすくなります。

- どのツールを使ったか(例:ChatGPT、Gemini、Copilot)

- いつ使ったか

- 何のために使ったか(例:構成整理、要約補助、表現調整)

- どの部分に使ったか(例:序論の構成整理のみ、本文の言い換え補助のみ)

また、阪南大学の学生向けガイドラインでも、利用申告がない場合や虚偽申告は不正行為と見なされることがあると案内されています。明記が必要か迷うときほど、書いておくほうが安全です。

そのまま使いやすい注記例

授業側で細かな書式指定がない場合は、次のような書き方なら過不足が出にくいです。

本レポートでは、構成案の整理および表現の見直しの一部に生成AIを利用した。使用ツールはChatGPT、利用日は2026年4月、利用目的は論点整理と文体の確認である。事実確認、引用確認、最終的な本文執筆は筆者が行った。

ここで大切なのは、「AIに任せた範囲」と「自分で確認した範囲」を分けて書くことです。透明性のある説明になれば、読み手も評価しやすくなります。

ChatGPT・Gemini・Copilotで注意点は変わる?

結論から言うと、多くの場合、大学での評価はツール名より使い方で決まります。ただし、大学が提供する組織向け環境か、個人契約のサービスかで、データ保護や利用条件の前提が変わることがあります。

ChatGPTで先に見たいポイント

OpenAIのデータ利用ポリシーでは、個人向けのChatGPTでは会話内容がモデル改善に使われる場合があり、オプトアウト(学習利用を止める設定)やTemporary Chatで制御できると案内されています。設定方法はOpenAIのData Controls FAQでも確認できます。つまり、個人情報や未公開資料を安易に入れないのはもちろん、設定を確認せずに授業資料や研究メモをそのまま貼るのは避けたほうがよいです。

Geminiで先に見たいポイント

GoogleのGemini Apps Privacy Hubでは、一部のチャットが人間レビュアーによって確認される場合があること、Keep Activityがオンのときは保存や改善利用の前提が変わることが案内されています。また、Keep Activityをオフにした将来のチャットはアクティビティに残らず、通常はAIモデルの学習にも使われませんが、72時間は保持されます。

そのため、Geminiは「便利そうだからとりあえず貼る」より、まずアクティビティ設定を確認し、授業資料・未公開情報・個人情報を入れない運用を徹底したほうが安心です。

Copilotで先に見たいポイント

Microsoft公式では、Microsoft 365 CopilotやMicrosoft 365 Copilot Chatのエンタープライズデータ保護が有効な環境では、プロンプト、応答、Microsoft Graph(Microsoft 365内の組織データ基盤)経由でアクセスしたデータが基盤モデルの学習に使われないと説明されています。

ただし、ここで重要なのは「大学が提供する組織向け環境かどうか」です。個人利用のCopilotと、大学アカウントで保護された環境は同じ前提ではありません。大学から案内されているアカウント種別や利用条件を必ず確認してください。

大学がMicrosoft 365やGoogle Workspace for Educationの組織アカウントを案内しているなら、まずそちらを確認するのが安全です。たとえば北陸大学のガイドラインは、大学契約のCopilotやGeminiではエンタープライズ保護が適用される一方、本学契約外の無料版・個人契約プランでは機微情報の入力を禁止すると案内しています。

提出前に迷わないための最終チェック

最後は、「バレるかどうか」ではなく、「説明できるかどうか」で見るのが安全です。AI検知ツールだけで不正の有無が決まるわけではありませんが、使い方が不透明だと疑われやすくなります。検知の話を整理したい方は、AI検知と不正扱いの最新動向もあわせて読んでみてください。

提出前チェック

- AIが作った本文をそのまま貼っていないか

- 出典・引用・事実関係を自分で確認したか

- AIを使った範囲を説明できるか

- 課題や授業で利用禁止になっていないか確認したか

- 個人情報・未公開情報・研究データを入力していないか

迷ったら、この順番で確認

- シラバスや課題要項で生成AI利用の記載を確認する

- 大学全体の学生向けガイドラインを確認する

- 曖昧なら、使う前に担当教員へ確認する

- 使った場合は、利用範囲と自分で確認した範囲を明記する

2026年の大学ルールは、AIを完全に遠ざける方向ではなく、学びを壊さない形で使う方向へ進んでいます。だからこそ、便利さだけで判断せず、「課題の目的」「透明性」「最終責任」の3点を外さないことが大切です。

よくある質問(FAQ)

大学で生成AIを使うのは基本的に禁止ですか?

一律禁止よりも、授業や課題ごとの条件付き運用が中心です。最終的には、大学全体の方針だけでなく、担当教員の指示が優先されると考えたほうが安全です。

要約や下書きだけならセーフですか?

補助利用にとどまるなら認められやすいですが、そのまま提出物の中核になると危険です。下書きや構成案の扱いが曖昧なときは、自己判断せず担当教員に確認してください。

AIを使ったことは毎回書いたほうがいいですか?

授業側で指定がある場合は必須です。指定がなくても、構成整理や表現調整など成果物に影響する形で使ったなら、ツール名・目的・利用箇所を明記しておくほうが安心です。

Copilotなら自動的に安全ですか?

そうとは限りません。大学の組織アカウントで保護された環境か、個人利用かで前提が変わります。ツール名だけで判断せず、大学から案内されている利用条件を確認してください。

教員に確認せずに使ってしまった場合はどうすればいいですか?

使った範囲を整理し、提出前に確認するのが基本です。隠したまま提出するより、何に使ったかを明確にして相談したほうが、後で説明しやすくなります。

まとめ:大学の生成AIガイドライン2026最新動向

この記事では、2026年4月更新の大学事例をもとに、大学での生成AI利用ルールを実践目線で整理しました。

- 一律禁止ではない:多くの大学は、全面禁止よりも授業・課題ごとの条件付き運用へ進んでいます。

文部科学省も、各大学が実態に応じて主体的に指針を見直すことが重要だと整理しています。

- そのまま提出は危険:北里大学と滋賀県立大学の4月更新事例では、AIの出力をそのまま使わないこと、最終責任は学生自身にあることが共通しています。

「補助利用」と「代作」は、同じAI利用でも評価が大きく変わります。

- 迷ったら透明性を優先する:ツール名、利用目的、利用箇所、自分で確認した範囲を示せる状態にしておくことが大切です。

大学ルールより授業担当教員の指示が具体的な場面も多いため、曖昧なときは先に確認してください。

生成AIは、使っただけで不正になる道具ではありません。ただし、使い方を誤ると、学びの目的を壊したり、不正行為と見なされたりする可能性があります。

これから使うなら、「課題の目的に合っているか」「そのまま提出していないか」「説明できるか」の3点を、提出前に必ず確認してみてください。